Music视频

@Music视频

58 分钟 前在线-

Qwen image Edit 2511

Qwen Image Edit 2511 是专业级智能图像编辑模型,聚焦”精准理解、可控修改、高效迭代”三大核心能力。模型基于多模态对齐的扩散-Transformer 混合架构,支持自然语言指令驱动的局部重绘、对象替换、风格迁移、背景移除与光影重构,可精准识别用户意图中的空间关系与语义层级,实现像素级编辑精度。

https://www.newvfx.co…[查看更多] -

Flux2-klein-9B

FLUX.2 [klein] 9B 是由 Black Forest Labs 推出的旗舰级轻量化文生图模型,专为实时图像生成与编辑场景打造。模型基于 90 亿参数的整流流(Rectified Flow)Transformer 架构,集成 8B Qwen3 文本编码器实现精准语义理解,并通过步骤蒸馏技术将推理压缩至仅需 4 步,达成亚秒级端到端生成速度 。

在核心能力上,FLUX.2 [klein] 9B 统一了文生图、单图编辑与多图参考融合三大任务,支持复杂提示词解析、多主体空间关系控制及高保真细节还原。相比前代及同尺寸模型,其在光影渲染、文字生成准确性与提示词遵循度方面表现更优,同时保持对消费级硬件的友好性(约 29GB 显存,RTX…[查看更多]

-

Z Image Turbo

一款面向高效视觉创作场景的新一代 AI 图像生成模型。正如其名,“Turbo”代表了其在推理速度与响应…[查看更多]

-

Qwen image 2512

Qwen Image 2512…[查看更多]

-

SeedVR2 是 Seed团队推出的顶级视频与图像修复(Video/Image Restoration)模型,是 2026 年影像修复领域的行业标杆。SeedVR2 是一款基于 Diffusion Transformer (DiT) 架构的通用影像修复大模型。它专注于解决视频与图像在现实世界中遇到的各种退化问题(如:画质模糊、噪点、低分辨率、旧胶片划痕等)。相比于初代 SeedVR,它通过“对抗性蒸馏(Adversarial Distillation)”技术,极大地缩短了推理时间。

7B 版本的核心跨越(相比 3B)

-

随着 AI 影像技术的爆发,从 FLUX 到 Z Image,从 Try-on 到 Depth Anything V2,各种模型层出不穷。为了帮助创作者在 Draw Things、ComfyUI 等工具中更高效地进行生产力配置,我将自己使用或者测试过的模型系统性地记录各类前沿模型的实测表现。

-

最近学习了Draw Things各种流程的使用,学习玩上方的cli语法与部署方法后,试着用Draw things cli的方式来执行流程,速度比图形界面快10-30%,根据上方语法写了这些测试的具体使用案例:我的模型路径在:/Users…[查看更多]

-

Draw Things CLI 结合 AI Agent 的本地图像生成方案,旨在通过命令行接口实现自动化与批量化图像生产。相较于传统图形界面(GUI),CLI 模式无需启动完整应用,可直接调用底层推理引擎,降低系统资源占用并提升生成效率。本指南提供从环境配置、核心命令到自动化工作流的完整技术路径,适用于视觉特效(VFX)概念设计、资产生成及流水…[查看更多]

-

使用 Premiere 内置的 VR Plane to Sphere 投影效果,将普通方形图像映射至 2:1 比例的等距柱状投影(Equirectangular)画布中。图像未覆盖的区域保留纯绿色背景,最终通过“导出单帧”生成标准全景贴图,便于后续在三维或合成软件中抠像或替换。

标准操作流程

① 创建 2:1 全景序列

1. File → New → Sequence

2. 分辨率设置为 4096 × 2048(推荐)或 2048 × 1024

3. 必须严格保持 2:1 宽高比,这是等距柱状全景图的标准规范。序列设置中开启VR功能,同时在播放器中右键开启VR模式显示。② 铺设纯绿色背景 创建新color matte…[查看更多]

-

一套“跨模型通用抠图/分离编辑 Prompt”(适配:Qwen Image Edit / FLUX / SDXL / 以及大多数图像编辑模型)。核心思路是:不依赖模型特性、用“约束 + 结构化语义”、避免模型各自乱发挥

🧴 1. 产品抠图(通用工业级)

Prompt

a clean subject cutout, isolated object, centered composition, studio lighting, high detail, sharp edges, perfect alpha matte, no background, transparent background, subject only, professional p… -

今天测试了 Qwen Image Edit 2509/2511的换脸方法

新的流程是:首先将原图放在画布上,把需要替换的人脸作为第二张图放入创意板。直接用提示词替换通常会失败,因为模型会强行保持原图人脸一致性。因此关键步骤是“消除原脸干扰”。具体做法是在画布中使用画笔工具(不是橡皮),将原图人脸区域涂成实心颜色,例如绿色或棕色。 -

最近我一直在想,如果一个影视剧中用到多个角色、能不能把角色制作成Lora,这样角色就能迁移、需要几个角色、只需要调用对应的ora组合就可以。想让AI 生成的各种场景中保持脸部、妆容一致,这就需要用到训练自己的ai Lora,通过 Draw Things 就能在本地训练属于自己的 LoRA 模型,当然也可以通过Comfyui等工具来训练。本文将基于最新的 FLUX.2/SD 架构界面,训练自己的AI 角色Lora。

训练AI 角色Lora操作方法

1. 准备数据集 (Dataset)

在界面的右侧 Dataset 区域:

添加图片: 点击 “Add” 按钮,上传 15-25 张…[查看更多]

-

这套方法的精髓在于利用 Qwen Image Edit 的局部编辑能力,配合 F2P (Face to Portrait) LoRA,实现从单一“脸部照片”到“全身/多风格肖像”的高保真转换。

一、 环境与资源准备

1. 基础模型:选择 Qwen Image Edit(基于通义千问的图像编辑模型)。

2. LoRA:加载 F2P LoRA(由 ModelScope 社区 Dent Studio 提供,基于一万多张高质量人像训练,兼顾特征一致性与人体审美)。

3. 软件工具:推荐使用 Draw Things 进行本地部署与操作。

二、 基础操作流程

-

使用SD ControlNet pose精准控制AI表情、手指与姿势:进阶工作流

第一步:提取完整骨架(含脸/手)

访问「哩布哩布AI」网站,上传参考图。ControlNet 类型选 OpenPose,预处理器务必选择 OpenPose Full。系统将输出包含身体坐标、手指关键点与面部五官点位的完整骨架图。这是实现同步控制的数据基础。第二步:导入 DrawThings 图层

将生成的骨架图拖入 DT 的 Pose 图层,或放入draw thi…[查看更多] -

很多人用 AI 画图,最大的痛点根本不是不会写提示词,而是“人物姿势总乱变”。同样输入“一个站立的人”,AI 可能随机生成几十种完全不同的姿态。做分镜、角色设计或视觉预演时,这种不确定性非常致命。

解决这个问题的核心工具就是 Pose ControlNet。它的作用很直接:把“人物怎么动”从 AI 的随机发挥中抽离出来,变成你可以完全掌控的固定框架。

下面以 DrawThings 为例,走一遍最清晰、最稳定的按照我们的预期动作生成图片的操作流程。文末附你提供的完整参数配置对照表,ComfyUI 用户可直接按相同数值平移。

-

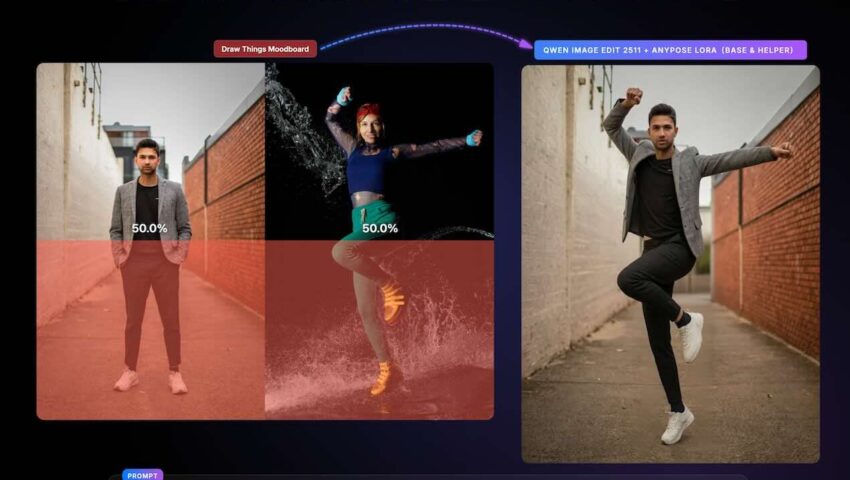

在最新的 AI 图像编辑领域,QIE-2511 AnyPose 提供了一种新的姿态迁移思路:不再依赖 OpenPose 骨架提取,而是直接通过图像理解实现动作迁移。该方法基于 Qwen Image Edit 2511,并结合 AnyPose LoRA,实现仅通过参考图片即可驱动人物动作变化。

一、核心思路

传统姿态迁移依赖 OpenPose 先提取人体骨架,再将骨架作为控制信号生成图像。这种方式结构稳定,但表达能力有限。

AnyPose 的核心变化是:直接使用“图像”作为姿态信号,由模型自行理解动作结构。也就是说,模型不再依赖显式骨架,而是通过视觉理解完成隐式姿态建模,使动作更加自然灵活。

二、模型…[查看更多]

-

追光 在版块 💻 Nuke合成影视制作 中发起了话题 CorridorKey:AI 如何重新定义绿幕抠像【AI制作】 6天, 19小时 前

在影视后期制作中,绿幕抠像一直是最基础却也最耗时的环节之一。无论是使用 Keylight、Primatte,还是各种 AI roto 工具,行业的核心问题始终没有真正解决:当主体边缘与绿幕发生颜色混合时,如何准确地还原真实前景。

传统方法的思路是“分离”——通过颜色判断生成 Alpha 遮罩,再配合 edge refine、despill、roto 等流程不断修补细节。然而这种方式本质上是在做二值或半连续的分类,它很难处理头发、运动模糊、半透明材质等复杂情况,最终往往需要大量人工干预。

CorridorKey 的出现,提出了一个完全不同的思路:不再去判断“哪里是前景”,而是直接重建“前景本身”。

它的核心能力在于对图像进行“反混合”(unmixing)。在绿幕拍摄…[查看更多]

-

随着生成式图像技术的发展,图像编辑正在从“工具操作”转向“语言驱动”,Qwen Image Edit、Fluxkelein2等模型正是这一趋势下的代表模型。它可以在本地(如 Draw Things)运行,通过简单的提示词完成复杂的图像生成与编辑任务。在许多场景中,它已经可以替代传统依赖 LoRA 或复杂流程的工作方式。

本文将系统梳理 Qwen Image Edit 的核心能力与实际应用场景。

一、人物一致性与多场景生成

Qwen Image Edit 可以基于一张人物基础图,生成该角色在不同场景下的表现,同时保持人物外观的一致性。

例如,同一个人物可以被快…[查看更多]

-

追光 在版块 Photoshop 平面设计社区 中发起了话题 用AI打造高级感视觉:玻璃社交名片 & 棱镜Logo完整教程 1周, 1天 前

最近在设计圈和社交媒体上,两种视觉风格非常火:霓虹玻璃面板社交名片,玻璃棱镜光谱 Logo,它们的共同特点是:未来感强、信息清晰、视觉高级。这篇教程将手把手教你,用 Qwen Image + Draw Things 实现这两种效果,而且是稳定、可控、可定制的专业流程。这里流程中使用的模型主要有俩种生图模型、图片编辑模型、可以使用qwen 模型也可以使用flux2、z image或者其他你喜欢的模型来制作。主要展示流程和提示词写。

一、核心方法思路(一定要先理解)

很多人会尝试“一步生成”,但效果往往:文字崩坏,排版混乱,不可控。

👉 正确方法是:…[查看更多]

-

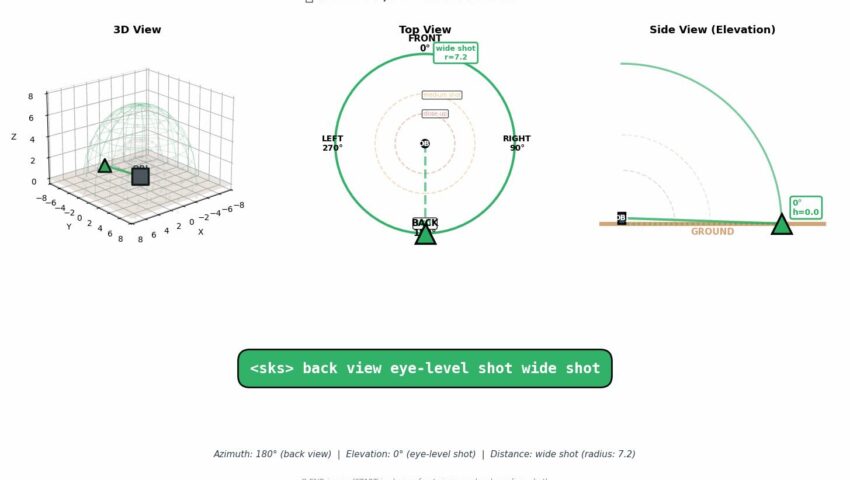

为了精准控制AI出图视角,我把 Qwen-Image-Edit-2511-Multiple-Angles-LoRA 的所有官方参数组合做成了结构化提示词库。8大方位 × 4种仰角 × 3种景别 = 96组标准写法,已按「正面/45°/侧面/背面」分段整理,每组自带使用场景备注,画角色卡、商业图,影视、游戏场景设计。

🔹 核心语法: [方位] [仰角] [景别](严格空格分隔,禁加标点/括号) 🔹 适用底模:Qwen/Qwen-Image-Edit-2511/2509 🔹 参数建议:LoRA强度 0.85~1.0,固定 Seed 可稳定生成角色三/四视图

该提示词可以在Comfyui和Draw things等调用支持Qwen image edit(1.0版本、2509…[查看更多]

- 查看更多